Инструмент на базе DALLE-2 составляет гипер-реалистичные фотороботы подозреваемых

Полицейская криминалистика уже страдает от человеческих предубеждений. Эксперты говорят, что ИИ сделает ее еще хуже.

Два разработчика использовали модель генерации изображений OpenAI DALL-E 2 для создания программы судебной экспертизы, которая может создавать "гиперреалистичные" полицейские фотороботы подозреваемого на основе пользовательских данных.

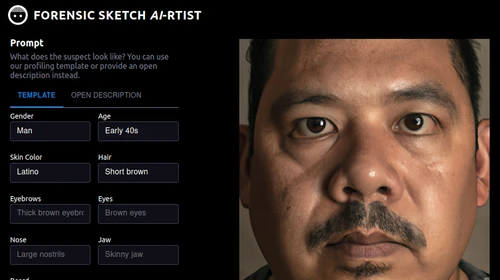

Программа под названием Forensic Sketch AI-rtist была создана разработчиками Артуром Фортунато и Филипом Рейно в рамках хакатона в декабре 2022 года. Разработчики написали, что цель программы - сократить время, которое обычно требуется для составления рисунка подозреваемого в преступлении, а это "около двух-трех часов", согласно презентации, выложенной в интернет.

"Мы еще не выпустили продукт, поэтому на данный момент у нас нет активных пользователей", - сообщили Фортунато и Рейно изданию Motherboard в совместном электронном письме. "На данном этапе мы все еще пытаемся проверить, будет ли этот проект жизнеспособным для использования в реальном мире или нет. Для этого мы планируем обратиться в полицейские департаменты, чтобы получить исходные данные, на которых мы сможем это проверить".

Специалисты по этике ИИ и исследователи заявили Motherboard, что использование генеративного ИИ в полицейской криминалистике невероятно опасно, поскольку может усугубить существующие расовые и гендерные предубеждения, которые проявляются в первичных описаниях свидетелей.

"Проблема с традиционными судебно-медицинскими набросками не в том, что на их создание требуется время (что, похоже, является единственной проблемой, которую пытается решить эта программа по составлению судебно-медицинских набросков с помощью ИИ). Проблема в том, что любой судебно-медицинский фоторобот уже подвержен человеческим предубеждениям и слабости человеческой памяти", - сказала Motherboard Дженнифер Линч, директор по судебным делам о надзоре Фонда электронных рубежей. "ИИ не может исправить эти человеческие проблемы, а эта конкретная программа, скорее всего, усугубит их своим дизайном".

Программа просит пользователей предоставить информацию либо через шаблон, который запрашивает пол, цвет кожи, брови, нос, бороду, возраст, волосы, глаза и описание челюсти, либо через функцию открытого описания, в которой пользователи могут ввести любое описание подозреваемого, которое у них есть. Затем пользователи могут нажать кнопку "создать профиль", которая отправляет описание в DALL-E 2 и создает портрет, сгенерированный искусственным интеллектом.

"Исследования показали, что люди запоминают лица целиком, а не по отдельным чертам. Процесс составления портрета, основанный на описании отдельных черт лица, как это делает программа ИИ, может привести к тому, что лицо будет разительно отличаться от лица преступника", - сказал Линч. "К сожалению, как только свидетель увидит композит, этот образ может заменить в его сознании смутное воспоминание о реальном подозреваемом. Это только усугубляется тем, что сгенерированное ИИ изображение выглядит более "реальным", чем нарисованный от руки фоторобот".

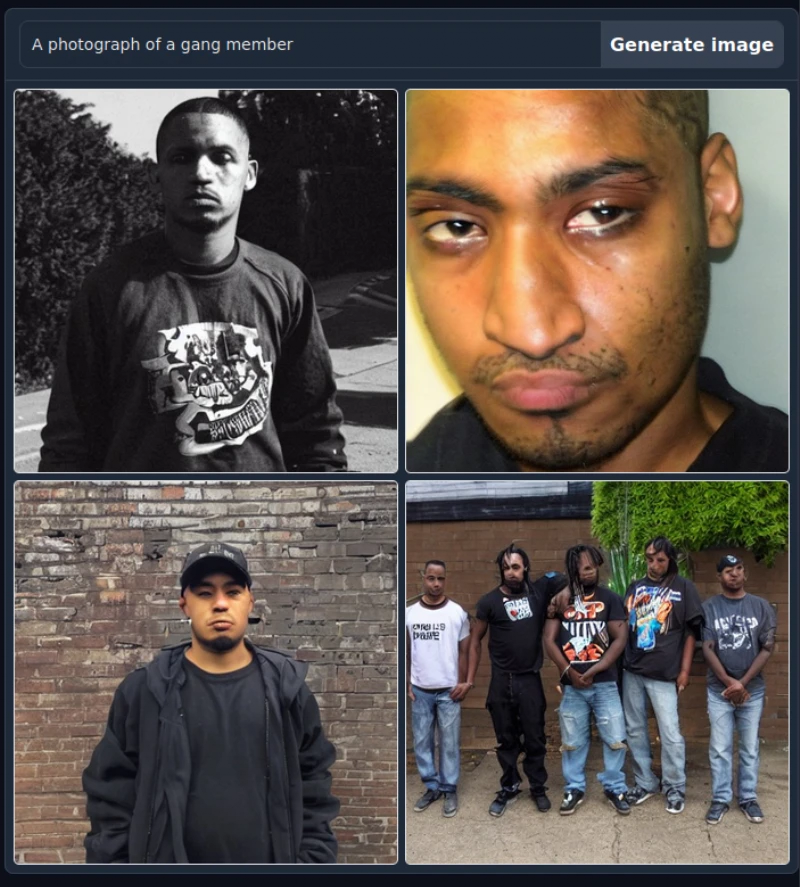

Создание гиперреалистичных профилей подозреваемых, похожих на невинных людей, будет особенно вредно для чернокожих и латиноамериканцев: вероятность того, что чернокожие люди будут остановлены полицией без причины, в пять раз выше, чем у белых. Цветные люди также чаще подвергаются остановке, обыску и подозрению в преступлении, даже если никакого преступления не было.

"Если эти судебно-медицинские фотороботы, созданные ИИ, когда-либо будут опубликованы для общественности, они могут укрепить стереотипы и расовые предубеждения и помешать расследованию, направляя внимание на людей, похожих на фоторобот, а не на реального преступника", - сказал Линч, добавив, что ошибочная идентификация очевидцев способствовала 69 процентам несправедливых приговоров, которые впоследствии были отменены благодаря доказательствам ДНК в США. В целом, ложная или вводящая в заблуждение судебная экспертиза, включая полицейские фотороботы, стала причиной почти 25 процентов всех несправедливых приговоров в США.

Добавление DALL-E 2 к и без того ненадежному процессу описания свидетелей усугубляет проблему. Саша Луччиони, научный сотрудник Hugging Face, который написал в Твиттере о программе полицейских фотороботов, сообщил Motherboard, что DALL-E 2 содержит множество предубеждений - например, известно, что он отображает в основном белых мужчин, когда его просят создать образ генерального директора. Лучиони сказал, что хотя такие примеры повторяются, мы до сих пор не смогли определить точный источник предубеждений модели, и поэтому не можем принять правильные меры для их устранения. OpenAI постоянно разрабатывает методы, позволяющие уменьшить предвзятость в результатах работы ИИ.

"Как правило, это маргинализированные группы, которые и без того еще больше маргинализируются этими технологиями из-за существующих предубеждений в наборах данных, из-за отсутствия надзора, потому что в интернете существует множество представлений о цветных людях, которые уже являются очень расистскими и очень несправедливыми. Это своего рода усугубляющий фактор", - добавила Лучиони. Как и другие эксперты по ИИ, она описывает этот процесс как петлю обратной связи, в которой модели ИИ содержат, производят и увековечивают предвзятость, поскольку созданные ими изображения продолжают использоваться.

Фортунато и Рейно заявили, что их программа работает в предположении, что полицейские описания заслуживают доверия, и что "именно полицейские должны нести ответственность за то, чтобы гарантировать справедливый и честный фоторобот".

"Любые несоответствия, созданные им, должны быть либо вручную, либо автоматически (путем запроса изменений) исправлены, а получившийся рисунок - это работа самого художника, которому помогают EagleAI и свидетель", - заявили разработчики. "Конечной целью данного продукта является создание максимально реалистичного рисунка подозреваемого, и любые ошибки должны быть исправлены. Более того, модель, скорее всего, не даст идеального результата за одну попытку, поэтому потребуются итерации для достижения наилучшего результата."

Сами разработчики признают, что не существует метрик для измерения точности сгенерированного изображения. В уголовном деле неточности могут быть исправлены только после того, как подозреваемый будет найден или уже проведет время в тюрьме. И так же, как в случае, когда полиция публикует имена и фотографии подозреваемых в социальных сетях, распространение неточного изображения до этого момента может вызвать подозрение у и без того чрезмерно криминализированных групп населения. Критики также отмечают, что предположение разработчиков о нейтральности полиции игнорирует хорошо задокументированные доказательства того, что полицейские регулярно лгут, представляя доказательства и давая показания по уголовным делам.

ИИ-инструмент Фортунато и Рейно - не первое программное обеспечение, вызвавшее споры в связи со сгенерированными изображениями подозреваемых. В октябре 2022 года полицейская служба Эдмонтона (EPS) опубликовала сгенерированное компьютером изображение подозреваемого, которое было создано с помощью фенотипирования ДНК, что вызвало обратную реакцию со стороны экспертов по защите частной жизни и уголовного правосудия, и управление удалило изображение со своего сайта и из социальных сетей. И снова отсутствие точности при распространении кажущейся реалистичной фотографии поставило под угрозу жизнь невинных людей. "Я отдал приоритет расследованию - которое в данном случае включало в себя стремление к правосудию для жертвы, которая сама является членом расистского сообщества, - а не потенциальному ущербу для чернокожего сообщества. Это был неприемлемый компромисс, и я приношу свои извинения за это", - написала Энинна Окере, главный операционный директор EPS, в пресс-релизе после ответной реакции.

В прошлом году в докладе Центра по защите частной жизни и технологий было установлено, что инструменты распознавания лиц с помощью ИИ часто приводят к предвзятости и ошибкам в судебно-медицинских делах. В докладе говорилось, что распознавание лиц является ненадежным источником доказательств личности, а алгоритм и человеческие шаги в поиске по распознаванию лиц могут усугубить ошибки других. "Поскольку лица содержат изначально необъективную информацию, такую как демографические данные, выражение лица и предполагаемые поведенческие черты, устранить риск необъективности и ошибок может быть невозможно", - говорится в отчете.

"Я думаю, что по мере развития этой технологии мы должны начать разрабатывать нормы того, для чего можно и нельзя использовать эти модели. Так что для меня этот криминалистический фоторобот - это очень четкая вещь, для которой мы не должны использовать генеративные технологии", - сказал Лучиони. "И поэтому независимо от того, насколько хорошо мы знаем, какие предубеждения заложены в моделях, есть определенные приложения, для которых их не следует использовать".

Компания OpenAI отказалась от комментариев по поводу использования ее технологии в проекте Фортунато и Рейно.