Искусственный интеллект на полях сражений.

Добрый день или добрый вечер уважаемые читатели!

Предлагаю новую публикацию

Опаснее ядерного оружия

В публикации об использовании искусственного интеллекта (ИИ) студентами и учениками школ для написания сочинений (подробнее: Подробнее ➤) я обратил внимание на проблемы педагогов при использовании новых технологий с использованием ИИ в системе образования. Но это цветочки, гораздо более сложные проблемы могут возникнуть у человечества при использовании ИИ в военных технологиях, недаром известный американский предприниматель и инженер Илон Маск считает ИИ более опасным, чем ядерное оружие.

ИИ начал активно разрабатываться в 90-х годах прошлого века, и скорее всего одними из заказчиков и инвесторов этих новых технологий были компании связанные с областями военных технологий. Так или иначе, но информация о разработках военных с использованием ИИ начала проникать в СМИ уже в нулевых годах нашего XXI века. И примерно в это же время появились первые призывы остановить разработки в этой области.

В 2015 году появилось обращение, подписанное десятками тысяч людей о приостановке таких исследований. В списке подписавших были такие известные люди, как уже упомянутый Илон Маск, учёный-физик Стивен Хопкинс, соучредитель компании Apple Computer Стив Возняк и другие.

Поистине, тревоги человечества после известного научно-фантастического фильма «Терминатор» выпуска 1984 года, становятся реальностью. Основной сюжет этого фильма - противостояние машин-убийц и человечества в будущем, которое переносится в наши дни противоборством киборга и робота за возможность изменить ход истории.

Фильм - фильмом, это идеи художников и создателей сценария, но действительность может оказаться более печальной

В США вице-президент и директор по исследованиям Центра новой американской безопасности Пол Шарре выпустил книгу «Армия без границ: автономное оружие и будущее войны». В этой книге описаны области, в которых ИИ в военных разработках уже выходит на практическое применение.

Так весной 2020 года во время гражданской войны в Ливии проправительственные войска при поддержке Турции атаковали силы сопротивления Халифа Хафтара с использованием облака беспилотных дронов и нанесли армии Халифа Хафтара существенные потери. Именно при этом применении был зафиксирован первый случай, когда ИИ (ударный квадрокоптер) в автономном режиме самостоятельно атаковал бойца ливийской армии и убил его (без команды оператора). Машина может уничтожить создателя - это уже не фантастика.

Ещё шесть лет назад в 2017 году президент России Владимир Путин сделал оценку по использованию искусственного интеллекта:

Но в этом выступлении была и следующая фраза:

"Здесь колоссальные возможности и трудно прогнозируемые сегодня угрозы"

Искусственный интеллект в военных технологиях

Эксперты называют несколько стран, которые находятся на первых позициях при разработке ИИ в военной сфере. К ним относят Великобританию, Россию, США, Израиль, Китай. У каждой страны есть новые прорывные технологии в этой сфере.

В США есть такой орган, как Управление перспективных исследовательских проектов Министерства обороны США (Defense Advanced Research Projects Agency) - DARPA. Это ключевой игрок в разработке новых военных технологий.

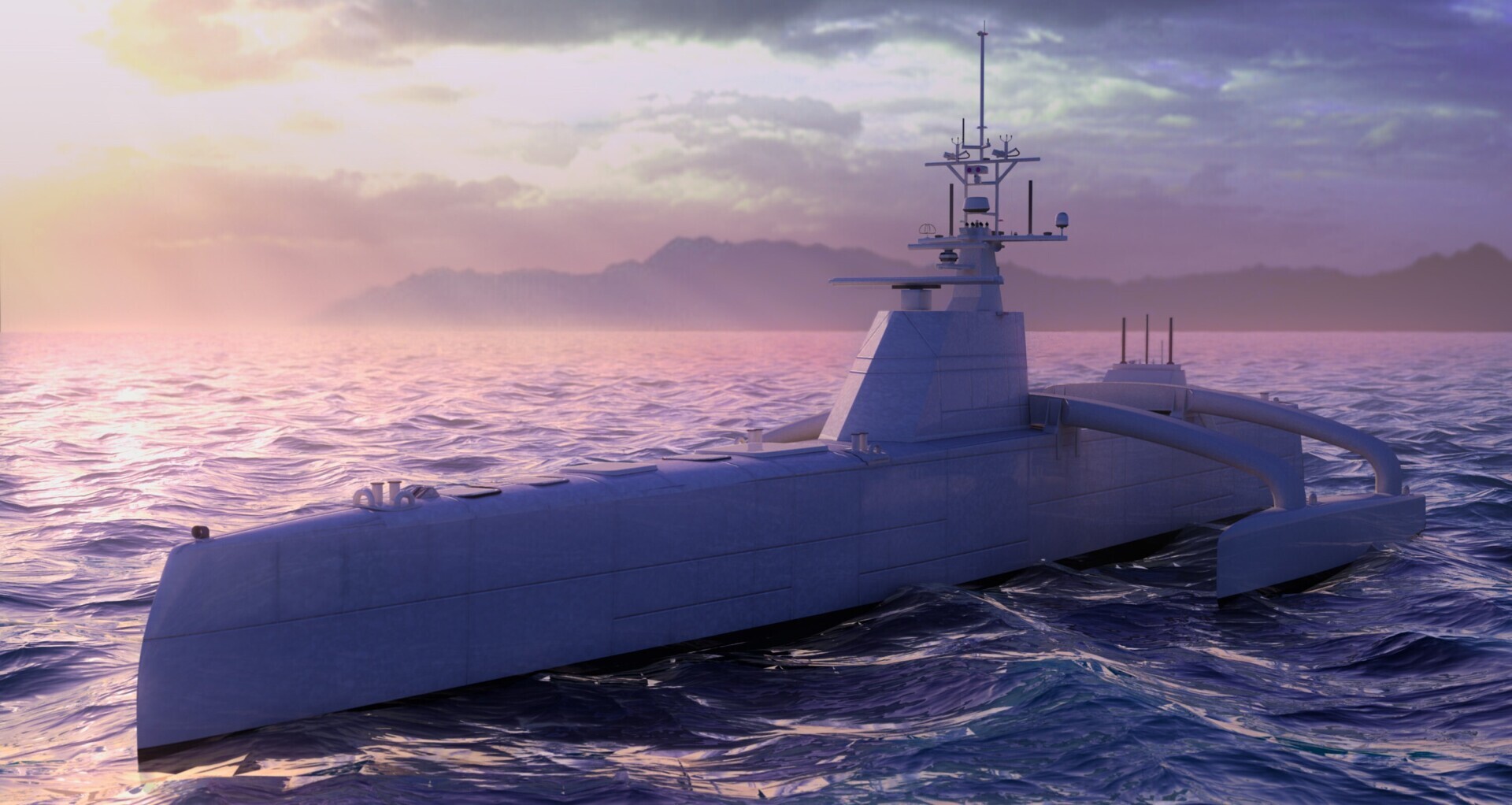

Так в 2017 году в США был представлен автономный военный корабль Sea Hunter, который способен выполнять боевые задачи без экипажа. Длина 40 метров, водоизмещение 145 тонн, скорость до 50 километров в час. Основная задача - борьба с подводными лодками.

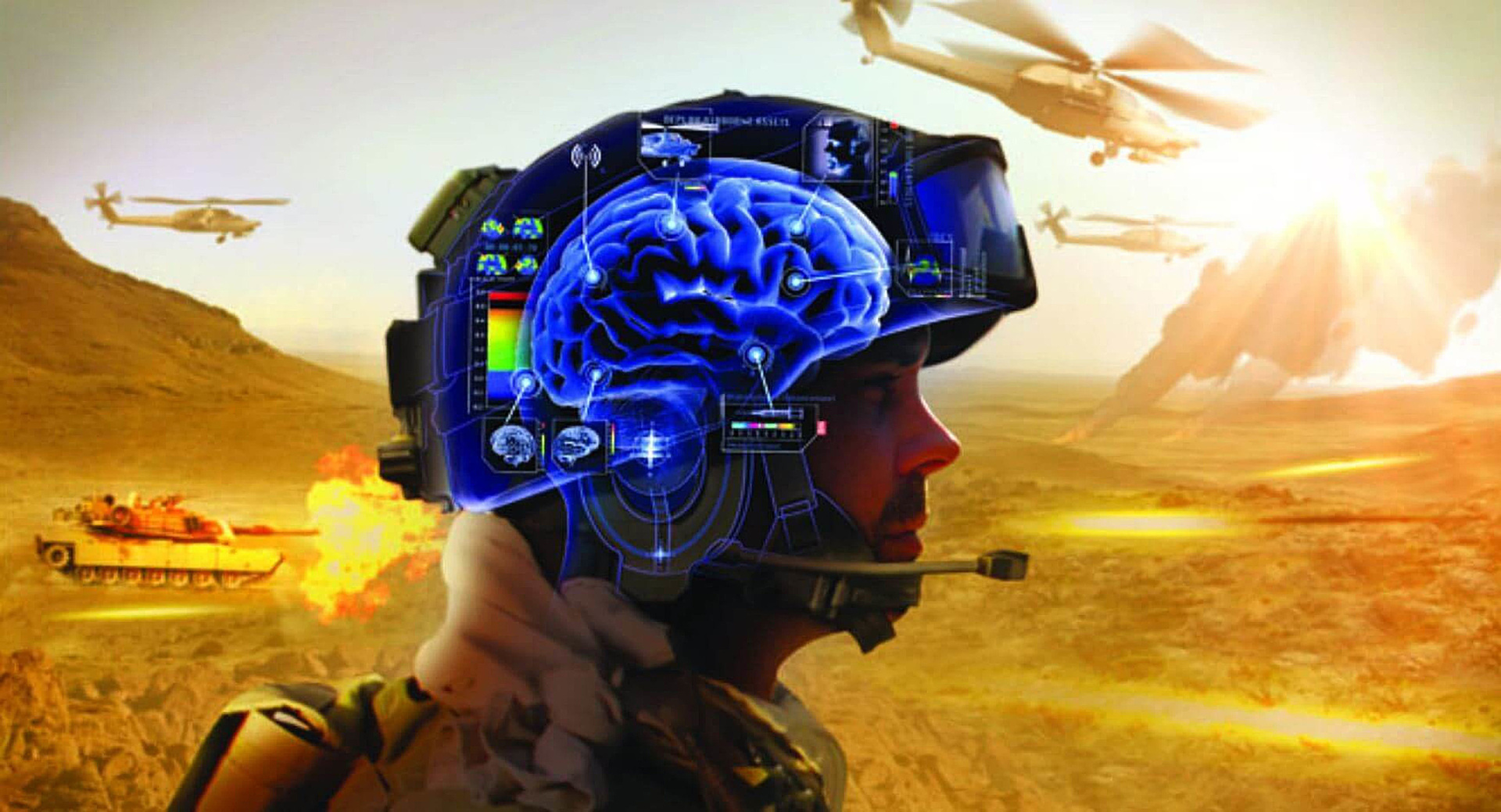

В США ИИ также тестируется (и применяется) при квалификации граждан при приёме на военную службу, при обучении солдат различным навыкам, при моделировании боевых тренировок. Одна из фишек разработок - создание особого шлема для военных с использованием ИИ. Это и компьютерное зрение, и множество других «примочек», чтобы солдат быстрее мог быстрее уничтожать своего противника и быть максимально защищённым. Гарнитура объединяет ночные, тепловые и носимые солдатом датчики с высоким разрешением.

В Великобритании также разрабатывают специальный шлем, а также специального робота для помощи раненным бойцам на поле боя. Разработан специальный документ для разработок ИИ в военных целях. Документ стратегии опубликован в прошлом году и в нём приоритет отдаётся для продвижения технологий с ИИ.

В Израиле разработан квадрокоптер Harpy (с англ. — «Гарпия»), которые способен патрулировать над заданной территорией и уничтожать станции наведения (РЛС). Кроме этого на выставке вооружений 2022 года был представлен сухопутный роботизированный танк M-RCV с электронной начинкой и 30-мм пушкой. В комплекте мультикоптер для проведения разведки в любых условиях в дневное и ночное время. В СМИ проходила информация, что Израиль использовал ИИ во время конфликтов в секторе Газа. В частности в 2021 году под руководством ИИ был использован рой дронов в секторе Газа.

Китай ведёт свои разработки на уровне двойного применения - и гражданское, и военное. По их планам продукция с использованием ИИ к 2030 году будет составлять не менее 150 миллиардов долларов. Как считают американские эксперты Китай достиг выдающихся успехов при использовании ИИ-систем для боевых операций и управления войсками. О разработках Китая мало информации, но в частности известно, что практически готова новая система пусковых установок "Дунфэн", которая управляется полностью ИИ и имеет полную защиту от беспилотников, радаров и спутников.

И наконец, Россия. Разработки в этой сфере не афишируются. Проходила информация, что новый танк Т-14 «Армата» будет поставляться в «беспилотном» режиме, то есть без экипажа. В таком же виде планируется выпуск самолётов СУ-57 из ОКБ Сухого. Это же ОКБ Сухого заканчивает разработку БПЛА С-70"Охотник", который будет полностью пилотироваться и управляться ИИ. По сообщению иностранных СМИ в России уже есть ракеты, оснащённые ИИ, способные во время полёта переориентироваться на другие цели.

Новые технологии не обходятся без курьёзов. В вышеуказанной книге автор Пол Шарре описывает случай, когда робота DARPA обучали на распознавание лиц. В течение недели 8 морпехов и инженеров находились в движении рядом с роботом. Потом была поставлена задача, подобраться до робота незаметно и отметиться. Все сумели эту задачу выполнить. Один нарядился в «ель» и походкой дерева добрался до робота, двое приблизились кувырками, двое надели на себя коробки и т.д. ИИ не смог «переработать» новые способы движения в его сторону.

Есть более глобальная проблема. Применение ИИ в военной области не регулируется международными нормами. «Гонка вооружений» в области разработки оружия с ИИ уже происходит и не регулируется никаким образом. Эксперты считают, что применение ИИ сравнимо по эффекту с ядерным оружием, но запретить применение такого оружия в ближайшее время невозможно. Что принесёт такое оружие - неизвестно.

Фото из открытых источников

Уникальность текста: 100.0%

Так искусственный интеллект это добро или зло для человека?

Проголосуйте, чтобы увидеть результаты

Шумиха, которая раздувается вокруг ИИ иногда настораживает...

Есть такое

Технологии БЕЗ правил?

Проходили?

Особенно с ненавидящим всех Байданутым?

это уже применяется в качества оружия - теже беспилотники

Красивые фото, в некоторых случаях нужны другие технологии, чем мы и успешно пользуемся...

Ты помнишь, как всё начиналось,

всё было впервые и вновь...

Одна из наиболее известных разработок в этой области - беспилотные самолеты, способные выполнять военные задачи без участия пилота. Такие самолеты уже активно используются в ряде стран, включая США.

Но возникновение ИИ в военных технологиях вызывает множество вопросов и опасений. Во-первых, есть опасность потери контроля над такими системами. Если ИИ станет слишком самостоятельным и возьмет на себя принятие решений, то военная система может начать действовать вопреки человеческим целям и ценностям.

Во-вторых, использование ИИ в военных технологиях может значительно повысить эффективность и точность ведения боевых действий. Это может привести к созданию новых видов оружия, которые будут способны наносить разрушительный ущерб с минимальными потерями для страны-разработчика. Это может привести к новым волнам гонки вооружений и угрозе взаимного уничтожения.

Третья проблема заключается в этической стороне использования ИИ в военных технологиях. Возникает вопрос о том, насколько правомерно доверять решениям и поступкам автономных систем, особенно если они принимают решения о жизни и смерти. Кто будет нести ответственность за возможные ошибки или непредвиденные последствия?

Эти проблемы вызывают серьезное беспокойство у многих людей, включая Илона Маска. Он заявляет, что ИИ является "самой большой угрозой для человечества" и требует серьезного регулирования и контроля его использования в военных целях.

Однако, несмотря на все опасения, разработка ИИ в военных технологиях продолжается. Поэтому важно вести открытый диалог, обсуждать эти проблемы и разрабатывать международные нормы и правила поведения при использовании ИИ в военной сфере, чтобы минимизировать возможные негативные последствия.

И не только у Вас.

И.Маск в США тоже выражает озабоченность отсутствия ПРАВИЛ

И ПОЗИТИВА при разработке ИИ?

Но пока у власти Байданутый(450млн.$ на Тайвань?)

ВСЕ МОЖЕТ быть?

Напишите Илону Маску?

Он взял перерыв ПОЛГОДА,чтобы затем ВЫРАБОТАТЬ

Международные Правила по ИИ?