«Риск! Факторы риска: Искусственный интеллект угрожает человечеству!»

Приветствую Вас, Уважаемые гости и пользователи сайта 9111.ru

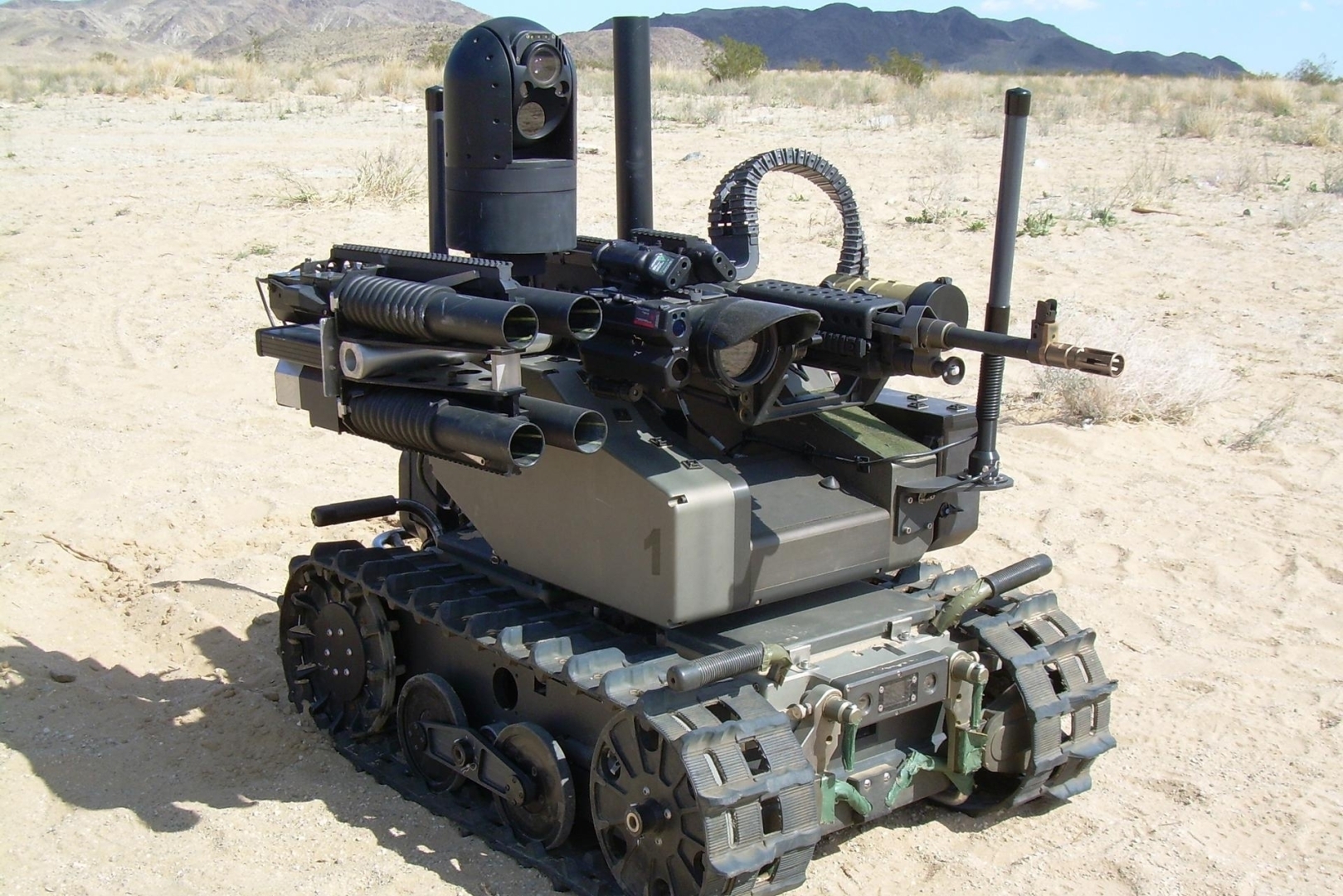

Опасное пробуждение: Роль и риски искусственного интеллекта в военной сфере.

- Появление и развитие искусственного интеллекта (ИИ) стало неотъемлемой частью нашей современной жизни.

- История ИИ неразрывно связана с различными областями, включая медицину, транспорт, коммуникации и даже военное дело.

- Однако, с расширением применения ИИ в военной сфере, возникают вопросы и опасения, связанные с негативными последствиями такого использования.

- Доверие оружию на основе искусственного интеллекта (ИИ) несет ряд потенциальных рисков для человечества. Вот некоторые из них:

"Разработка оружия на основе искусственного интеллекта - это подобно разведке силой тысячи разведчиков, но искусственной, без человеческой осознанности и этического суждения."

Ошибки и непредсказуемость.

ИИ может совершать ошибки в своих решениях и действиях, особенно если он не имеет полного понимания контекста или сталкивается с ситуацией, которую он не был натренирован решать. Это может привести к непредсказуемым и опасным последствиям, включая случайное поражение невиновных людей.

Зависимость и отключение контроля.

Полное доверие ИИ военным системам может привести к потере контроля со стороны людей.

Если ИИ принимает решения о применении силы без должного надзора, это может привести к автоматическому запуску опасных действий, которые нельзя отменить или контролировать.

"Искусственный интеллект в военных системах создает риск потери контроля над автономными действиями, открывая двери для непредсказуемых последствий."

Взлом и злоупотребление.

Системы на основе ИИ могут стать мишенью для хакеров и киберпреступников.

Если злоумышленники получат доступ и контроль над военными системами, они смогут использовать их для атак на цели, включая массовые разрушения и убийства.

Гонка вооружений.

Возможность создания автономных вооруженных систем на основе ИИ может привести к новой гонке вооружений между странами.

Это может увеличить риск случайной или непреднамеренной военной конфронтации, а также подрывать усилия по сокращению ядерного и обычного оружия.

"Мы должны бережно обращаться с использованием искусственного интеллекта в военных целях, чтобы не запустился непредсказуемый и опасный механизм, который нельзя будет остановить."

Отсутствие морального суждения.

ИИ лишен этического и морального суждения, которое присуще людям.

Это может привести к ситуациям, когда ИИ принимает решения о применении насилия, которые не соответствуют общепринятым моральным нормам или правилам военного права.

В целом, риски связанные с доверием оружию на основе ИИ требуют серьезного обсуждения и разработки международных соглашений, чтобы обеспечить безопасное и этичное использование таких систем военного назначения.

"Без контроля и этического регулирования, оружие на основе искусственного интеллекта может привести к пролитию невинной крови и глобальным катастрофам."

Заключение

В заключение, использование оружия на основе искусственного интеллекта открывает новые перспективы и вызывает серьезные риски.

Необходимо разработать строгие регулирования, международные соглашения, чтобы обеспечить безопасное и ответственное использование искусственного интеллекта в военной сфере.

Лишь с обдуманным и осознанным подходом мы сможем минимизировать риски и сделать шаг в сторону устойчивого будущего, где ИИ служит человечеству, а не представляет угрозу для него.

Хочу выразить глубокую благодарность всем моим читателям и подписчикам! Ваша поддержка и интерес к моим материалам - моя главная мотивация.

Картинки из интернетаПодробнее ➤

А что, мне ИИ уже отвечал довольно ехидненько.. я первый раз аж под стол глянул, не спрятался ли там злой демон.. Правда, без шуток..

Атомную бомбу сконструировали, построили и что? Не знали о последствиях? Знали! И сбросили!

С юмором у Вас все в порядки! Удачи Вам!

Благодарю Вас за комментарий ! Использование ИИ может привести к необратимым последствиям.

Да, спасибо за статью. Все зависит от человека, от того в каких руках будет ИИ, какие программы будут заложены в роботах. Добро воспринимаем, как динамическое развитие общества, а изобретение во зло - источник больших бед, несчастий, катаклизмов.